Vibe coding con Gemini: come creare un interprete vocale bilingue

Il vibe coding è un approccio che sta rivoluzionando il mondo della programmazione, grazie all’integrazione dell’intelligenza artificiale generativa. Questo paradigma consente di partire da un’intuizione o da un’idea generale, trasformandola in codice attraverso un processo iterativo e collaborativo con l’AI.

Un esempio pratico di questa metodologia è la creazione di un interprete vocale bilingue, che sfrutta tecnologie come la Web Speech API e la Gemini API di Google per tradurre in tempo reale.

Indice degli argomenti

Cos’è il vibe coding

Il concetto di vibe coding emerge in un contesto in cui l’intelligenza artificiale è sempre più vista come un’estensione dell’ingegno umano. Lungi dall’essere un sostituto, l’AI rappresenta un potenziatore delle capacità cognitive e progettuali, offrendo nuovi strumenti e modalità per esprimere idee e realizzare progetti complessi in tempi rapidi.

In questo modello, lo sviluppatore parte da un’idea generale, una sensazione, un intento o un obiettivo finale, piuttosto che da specifiche dettagliate. L’AI, in questo contesto, funge da collaboratore attivo: interpreta, propone, scrive codice e si adatta ai feedback dell’utente. Il processo è per sua natura iterativo: si parte da un prompt iniziale, si valuta l’output, si danno indicazioni, si corregge, si prova, si ripete. È una danza continua tra intuito umano e potenza computazionale, che porta a soluzioni sorprendenti e spesso più rapide rispetto ai metodi tradizionali.

Questo approccio cambia il modo di concepire il rapporto con il codice: non più una relazione verticale dove il programmatore impartisce comandi, ma una collaborazione orizzontale tra creatività umana e capacità computazionale. La flessibilità del vibe coding lo rende adatto anche a contesti educativi e sperimentali, dove la comprensione del codice può avvenire progressivamente durante il processo stesso.

Il vibe coding ha anche una forte dimensione culturale e creativa: mette al centro l’esperienza dell’utente, la sua visione, i suoi obiettivi, e consente di esplorare soluzioni multiple partendo da suggestioni anche vaghe. È una forma di prototipazione dialogica, in cui il prompt agisce come innesco e l’AI risponde come interlocutore.

Caso studio: lo sviluppo di un interprete vocale bilingue

L’obiettivo del progetto è ambizioso e ricco di implicazioni pratiche: sviluppare un’applicazione web (basata su HTML, CSS e JavaScript) in grado di:

- Ricevere input vocale continuo tramite Web Speech API;

- Riconoscere automaticamente se la lingua parlata è italiano o inglese;

- Tradurre il testo nella lingua opposta, utilizzando la Gemini API di Google;

- Emettere la traduzione tramite sintesi vocale, sempre in tempo reale;

- Salvare ogni scambio in file di log, con gestione automatica della dimensione;

- Offrire un’interfaccia intuitiva, responsiva e facilmente accessibile da browser moderni.

Un sistema simile può essere utile in contesti formativi, conferenze, viaggi, interazioni mediche internazionali o ambienti multilingue, dove la comunicazione simultanea diventa cruciale. Inoltre, può rappresentare un potente strumento di accessibilità, facilitando la comprensione tra persone con background linguistici differenti. La possibilità di interagire con un’applicazione vocale che si adatta dinamicamente al contesto linguistico rappresenta un’innovazione strategica, anche per aziende che operano su mercati globali.

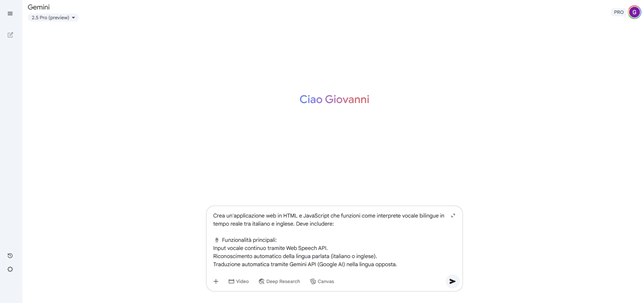

Fase 1: il vibe iniziale e il prompt

Tutto ha inizio da una visione chiara delle funzionalità desiderate. Quella visione si traduce in un prompt dettagliato per Gemini, contenente:

- Specifiche tecniche (linguaggi, API, dimensioni file);

- Comportamenti attesi (interazione, lingua, logging);

- UI desiderata (bottoni, titoli, area conversazione);

- Requisiti di compatibilità e performance.

Esempio di prompt: “Crea un’applicazione web in HTML e JavaScript che funzioni come interprete vocale bilingue in tempo reale tra italiano e inglese. Deve includere:

🎙️ Funzionalità principali:

- Input vocale continuo tramite Web Speech API.

- Riconoscimento automatico della lingua parlata (italiano o inglese).

- Traduzione automatica tramite Gemini API (Google AI) nella lingua opposta.

- Sintesi vocale (Text-to-Speech) della traduzione.

📝 Logging:

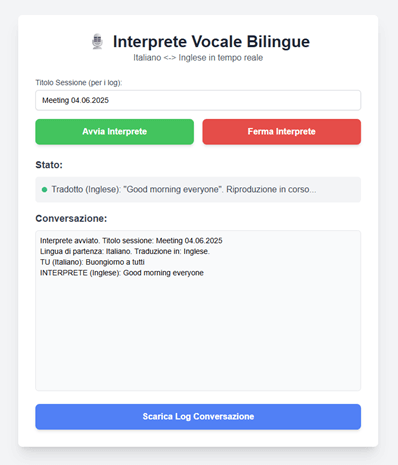

- Prima di iniziare, l’utente deve inserire un titolo della sessione.

- Il titolo sarà usato come prefisso per i file di log (TitoloSessione_1.txt, TitoloSessione_2.txt, ecc.).

- Ogni frase parlata e la rispettiva traduzione devono essere salvate in un file di testo.

- Quando il file raggiunge 1 MB, ne viene creato uno nuovo automaticamente.

- Alla fine, l’utente può scaricare tutti i file di log.

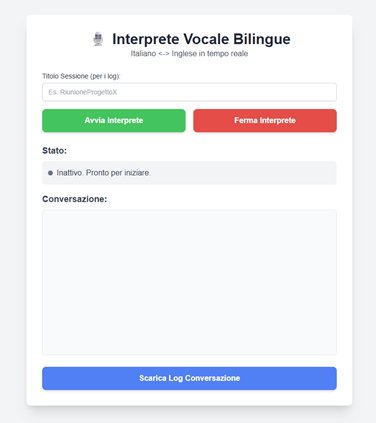

💬 Interfaccia utente:

- Campo per inserire il titolo della sessione

- Pulsante “Avvia interprete”

- Pulsante “Ferma interprete”

- Area per visualizzare la conversazione (input + traduzione)

- Quando il testo supera una soglia (es. 2000 caratteri), viene automaticamente ripulito

- Pulsante “Scarica conversazione”

⚙️ Tecnologie richieste:

- Web Speech API per input vocale continuo e sintesi vocale

- Gemini API di Google per la traduzione automatica

- Tutto deve funzionare in browser moderni (es. Chrome)

- Se necessario, implementa autenticazione per usare l’API Gemini”

Il prompt funziona come un vero e proprio contratto semantico tra sviluppatore e AI: più è preciso e ben costruito, maggiore risulta la coerenza dell’output iniziale generato da Gemini. La capacità di definire prompt efficaci rappresenta una competenza sempre più centrale nel vibe coding e costituisce una nuova forma di alfabetizzazione digitale.

Definire il prompt è un’arte: occorre equilibrio tra chiarezza e apertura, precisione e possibilità. Un prompt troppo chiuso vincola l’AI, uno troppo generico la disorienta. Trovare il giusto tono è il primo passo verso una collaborazione efficace.

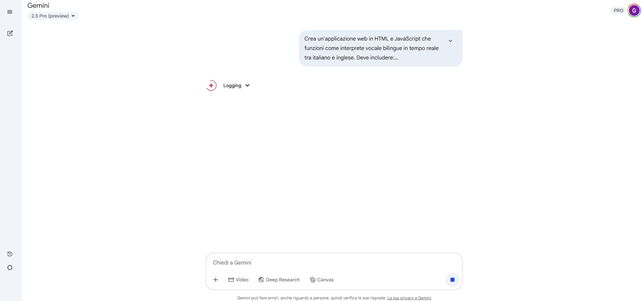

Fase 2: prima bozza del codice

Gemini elabora il prompt e, in pochi istanti, restituisce una prima versione del codice sorgente. L’applicazione risultante include una struttura HTML con layout flessibile, uno stile CSS moderno tramite Tailwind e logica JavaScript per orchestrare input, traduzione e output audio.

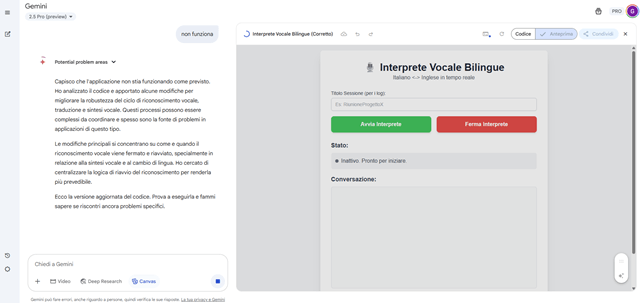

Fase 3: iterazione e debugging

Qui inizia la parte realmente creativa del processo: l’interazione continua tra AI e sviluppatore.

- Primo test – Il codice viene copiato in un file locale e avviato su browser. Risultato: “non funziona”. Nessun output visibile, nessuna interazione.

- Feedback umano – L’utente fornisce un commento generico, poi via via più preciso, fino a identificare problemi con la logica del riconoscimento vocale.

- Secondo test – Emergono alcuni bug: i pulsanti “Avvia” e “Ferma” non producono alcun effetto. Gemini corregge gli event handler.

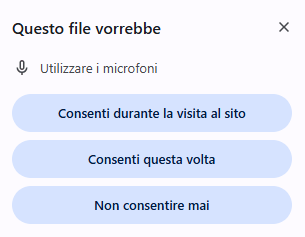

- Problemi con il microfono – L’app richiede il permesso ad ogni input.

- Gemini aggiorna il codice, migliorando la gestione dei permessi secondo le best practice di Chrome.

Questa fase è durata diverse iterazioni, ciascuna delle quali ha migliorato il codice, fino a ottenere un’applicazione stabile e reattiva, pronta all’uso. Ogni passaggio è stato anche un’occasione di apprendimento, confermando che il debugging guidato da AI non elimina l’intervento umano, ma lo orienta meglio. L’AI diventa così anche uno strumento pedagogico, utile per comprendere meccanismi complessi attraverso esempi concreti.

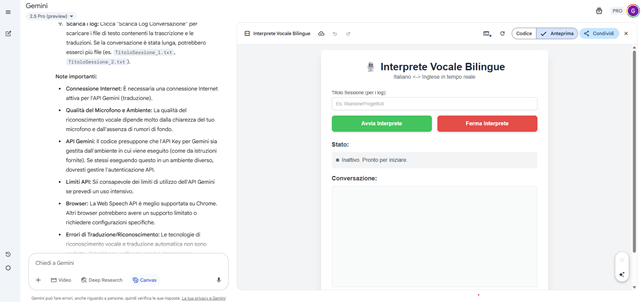

Fase 4: il risultato finale

Il progetto raggiunge pienamente il suo obiettivo. L’interprete bilingue funziona correttamente: riconosce la voce in tempo reale, traduce in modo fluido, riproduce l’audio e salva automaticamente i file in locale.

L’app viene testata come applicazione autonoma: tutto il codice viene salvato in un file .html, eseguito da browser, dimostrando piena indipendenza dall’ambiente AI. Questa indipendenza è fondamentale per verificare che la soluzione sia portabile e riproducibile. Il file generato può essere distribuito, adattato o integrato in contesti più complessi, come applicazioni mobili o sistemi multilingua.

Guida pratica al Vibe Coding con Gemini

Ecco una serie di buone pratiche per adottare il vibe coding con successo:

- Definisci un vibe solido – Parti da un obiettivo chiaro. Anche se non dettagliato, deve essere concettualmente robusto.

- Prompt dettagliato ma flessibile – Includi linguaggi, funzionalità, comportamenti. Lascia spazio all’AI per proporre.

- Itera consapevolmente – Fornisci feedback puntuali, specifici e costruttivi.

- Sfrutta gli strumenti – Canvas, anteprima, debugging sono essenziali.

- Accetta suggerimenti creativi dell’AI – Spesso Gemini propone soluzioni alternative valide.

- Debug umano tradizionale – Console, test localizzati, log, tutto resta utile.

- Test finale indipendente – Isola il codice, verifica che sia davvero autonomo.

- Documenta ogni passaggio – Annotare problemi, iterazioni e soluzioni aiuta a migliorare il prompt e la gestione futura del codice.

- Verifica la compatibilità cross-browser – Un’applicazione efficace deve essere testata su più ambienti.

- Sperimenta e sbaglia – Il vibe coding è anche un processo creativo che ammette l’errore come fase del progresso.

- Analizza le soluzioni AI – Impara dai suggerimenti dell’AI, anche quando non li adotti.

- Integra risorse esterne – Librerie, fonti dati, API possono arricchire il progetto.

Conclusioni

Il vibe coding, facilitato da strumenti evoluti come Gemini, non sostituisce le competenze dello sviluppatore: le amplia, le integra e le esalta. La figura del programmatore si evolve in quella di un direttore creativo, capace di orchestrare le capacità dell’intelligenza artificiale per costruire soluzioni complesse, funzionali ed eleganti in tempi estremamente ridotti.

Il caso dell’interprete vocale bilingue dimostra come un’idea iniziale possa trasformarsi, in modo collaborativo e iterativo, in un’applicazione web pienamente funzionante. È un assaggio concreto di un futuro in cui la creazione del software sarà sempre più intuitiva, accessibile e allineata alla visione creativa dello sviluppatore.

Un percorso che segna una nuova fase della programmazione: non più solo tecnica, ma profondamente ispirata, conversazionale e aperta all’imprevisto generativo dell’intelligenza artificiale. In questo scenario, l’AI non è più solo uno strumento di supporto, ma un vero e proprio partner di progetto, con cui costruire, sperimentare e innovare. Il vibe coding rappresenta una sintesi tra visione e tecnica, tra intuizione e calcolo, tra umanità e algoritmo.