Tra le tecnologie abilitanti l’industria 5.0, un ruolo importante è rivestito dall’intelligenza artificiale e dalla robotica collaborativa, tecnologie in grado di ridisegnare i paradigmi di produzione in diversi settori e di modificare il rapporto tra macchina e uomo così come è stato inteso tradizionalmente.I cobot sono una leva per un’industria che si avvia verso la fase 5.0 della propria evoluzione, con notevoli cambiamenti sulla società e nuovi scenari di applicazione di tali innovazioni.Indice degli argomenti

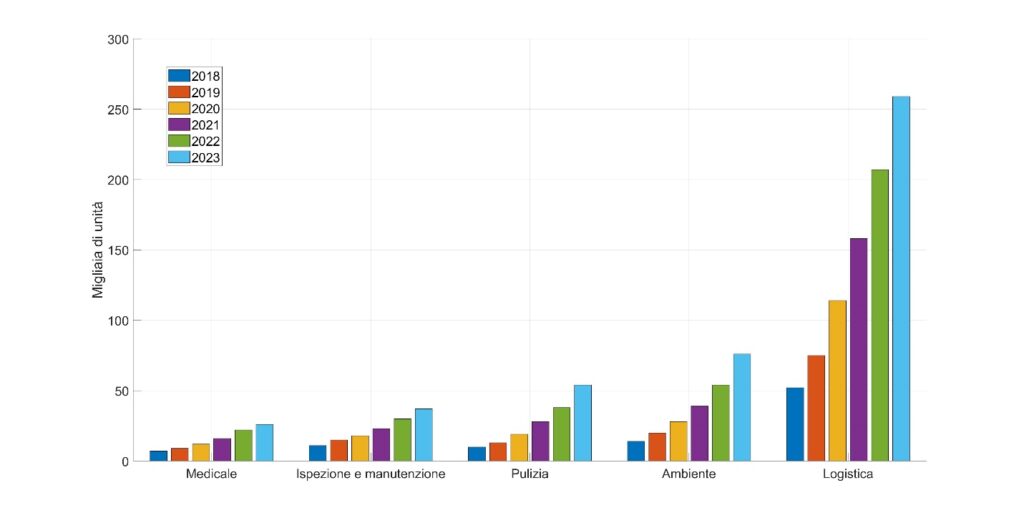

Il ruolo della robotica nell’industriaFino ad ora i robot sono stati principalmente impiegati in ambito industriale per tutte quelle operazioni usuranti o negli ambienti ostili in cui potesse sostituire l’uomo, si pensi alle operazioni di saldatura, verniciatura, di manipolazione di carichi ripetitivi o usuranti.L’impiego principale è da sempre stato nei settori tradizionali industriali quali il settore automobilistico, elettronico, della manifattura e della lavorazione dei metalli, per compiti quali la manipolazione di oggetti, la saldatura e l’assemblaggio in primis (dati tratti da international Federation of Robotics (IFR 2020).Il 2006 è stato il primo anno in cui il maggior numero di robot è stato impiegato fuori dal ramo dell’industria automobilistica, andando oltre il driver iniziale delle 3D che avevano favorito lo sviluppo della robotica industriale, ovvero ridurre o eliminare i lavori “ripetitivi, pericolosi e sporchi”, dall’inglese “Dull, Dangerous and Dirty” (Østergaard 2018).Anche se non così ben noto ai più, l’Italia rimane uno dei paesi principali utilizzatori di robot. Si deve considerare che nella classifica mondiale dei paesi utilizzatori di robot guidata dalla Cina con poco più di 140,000 unità per anno, l’Italia è posizionata in sesta posizione con 11,000 unità per anno, dietro Giappone, Stati Uniti, Corea e Germania confermando la sua vocazione industriale di paese manifatturiero, oltre che leader nel settore della robotica ed automazione industriale. Questo dato economico indiretto di per sé è infatti un indicatore positivo della dimensione economica industriale del nostro paese Italia.Che cos’è la robotica collaborativaCon robotica collaborativa ci si riferisce a quei sistemi robotici di nuova generazione che sono in grado di interagire fisicamente in sicurezza con l’uomo e di condividerne lo spazio, non rimanendo pertanto più confinati in una “gabbia” che separa lo spazio dell’uomo da quello del robot. Un vero e proprio cambiamento che apre la strada ad una modalità diversa di impiego della robotica in ambito industriale e non solo.Nell’interazione fisica uomo-robot PhHRI ovvero Physical Human-Robot Interaction gli aspetti della percezione dell’ambiente e la previsione dell’intenzione umana rappresentano un requisito fondamentale che deve possedere il robot collaborativo per poter coesistere e collaborare in sicurezza con l’uomo.In questo modo si viene a costituire un binomio uomo-robot che operando insieme beneficiano mutuamente dell’azione coordinata di entrambi. Il robot è in grado di sollevare l’uomo dalle operazioni gravose con un rischio biomeccanico elevato, quali ad esempio il trasferimento e la manipolazione di carichi elevati, l’esecuzione di mansioni ripetitive ed usuranti, e d’altro canto il robot può beneficiare delle abilità individuali dell’uomo, in grado di prevedere e risolvere situazioni imprecise, adattarsi alla flessibilità e alla variabilità dei compiti (Pieskä and Kaarela 2018).Le applicazioni dei cobotUn’applicazione rilevante del robot 4.0 è la possibilità di movimentare carichi da un punto all’altro in ambienti arbitrari, manipolando oggetti di diverso tipo, in un ambiente comunemente condiviso con gli esseri umani, anche in un layout di impianto altamente flessibile e non strutturato, come tipicamente accade nella piccola media impresa, dove è richiesta una maggiore flessibilità di linea e di prodotto.A tal fine, possiamo identificare un requisito importante che i robot devono soddisfare, ovvero la capacità del robot mobile di implementare la navigazione naturale in ambienti non strutturati, con la capacità di eseguire anche l’ottimizzazione del percorso, basata su sensori di visione artificiale LIDAR multipli e SLAM ottimizzati.Le previsioni per i cobot: una tecnologia in crescitaQuesto rivoluziona da un lato l’utilizzo dei robot nei settori tradizionali, quali quello dell’automazione, ad esempio nel settore automobilistico e della manifattura, dall’altro apre dei nuovi settori importanti industriali, in quello che viene definito il mercato della robotica di servizio.La robotica di servizio trae infatti nuova linfa attraverso applicazioni nel settore industriale ed anche civile, sia domestico sia professionale. E l’innovazione in questo ambito viene fatto per la gran parte da aziende start-up innovative che sono in grado di generare nuove idee di robotica, portando sul mercato soluzioni innovative e paradigmi originali di interazione con l’uomo e di produzione.Dai dati estratti dall’ultimo report IFR 2020 della International Federation of Robotics sulle prospettive di crescita della robotica di servizio, si vede come il settore indubbiamente in crescita maggiore in termini di migliaia di unità impiegate sia quello della robotica per la logistica .Figura 1 – Rappresentazione grafica delle unità di robot vendute nei diversi settori , elaborazione grafica sulla base dei dati di IFR 2020, con una proiezione dei dati fino al 2023.Casi aziendali, dove trovano impiego i cobotUn grosso impulso in questa direzione è stato dato anche da aziende come Amazon, che ha investito notevolmente nell’automazione dei propri magazzini.È il 2003 quando viene fondata a Boston Kiva Systems, definita “Kiva the Disrupter” dalla Harvard Business Reviews (Mountz 2012) , riconosciuta oggi come una delle aziende che ha rivoluzionato il mercato della robotica per la logistica, i cui fondatori sono annoverati nella “National Inventors Hall of Fame” (NIHF). americana, con l’obiettivo di introdurre un nuovo concetto di piattaforme robotiche in grado di cambiare la logistica tradizionale. E’ storia nota che Amazon poi nel Marzo 2012 acquisì Kiva Systems per 775 milioni di dollari.Tra le storie di successo made in Europe, Swisslog nel 2014 viene invece acquisita da Kuka, e diventa uno degli attori protagonisti della logistica 4.0, realizzando soluzioni di automazione all’avanguardia per centri di stoccaggio e distribuzione orientati al futuro, registrando nel solo comparto della logistica nel 2019 ordini per 750,2 milioni, segnando un +24,8 % rispetto all’esercizio del 2018. E sono tante le altre storie di successo che si potrebbero raccontare simili a queste, che delineano un chiaro modello di “open innovation” nella robotica. Come evidenziato dalla grafica sopra riportata, un altro settore in forte espansione è rappresentata dalla robotica per pulizia.La Gaussian Robotics, fondata a Shanghai nel 2013, è un’azienda di Shanghai che sta rivoluzionando il mercato della pulizia robotica, la quale ha chiuso a Settembre 2020 un round da 22 milioni di dollari. E’ interessante notare che il fondatore e CEO di Gaussian Robot Cheng Haotian si è laureato presso l’Università di Cambridge in Ingegneria Elettronica, per tornare quindi poi in Cina e portare una innovazione dirompente in questo settore.La robotica collaborativa nella pandemia da coronavirusIn questo periodo di pandemia anche la robotica per disinfezione ha dimostrato di poter dare un contributo fondamentale per la sanificazione degli ambienti attraverso irradiazione UV-C o il rilascio controllato di vapori freddi, tutelando quindi la sicurezza dell’uomo (Tiseni et al. 2021),Figura 2 – Esempio di robot di disinfezione mediante radiazione UV-C sviluppati presso la Scuola Sant’Anna.La manutenzione predittivaNon da ultimo, e non meno trascurabile, è la categoria dei robot per ispezione e per la manutenzione, che grazie alle tecnologie di visione artificiale potenziate dall’Intelligenza Artificiale sono in grado di potenziare il paradigma della manutenzione predittiva, ovvero un tipo di manutenzione che prevede ed anticipa il guasto, attraverso la misura con sistemi di sensori di parametri fisici di sistema e di modelli matematici che consentono di identificare il tempo residuo prima del guasto.Verso Industria 5.0Ma anche nell’ambito industriale tradizionale la robotica collaborativa introduce un importante cambio di paradigmi, pienamente in linea e sintonia con il concetto di Industria 5.0, un paradigma di produzione per un’industria più sostenibile, resiliente e incentrata sull’uomo, in accordo alla doppia transizione verde e digitale (EU Directorate 2021). Industria 5.0 nasce anche dal desiderio di restituire l’uomo al centro del processo di manifattura e produzione, e di poter quindi usare la tecnologia per ritornare a dare valore all’uomo nel processo di manifattura, con la possibilità della personalizzazione anche nella produzione di massa. I prodotti dell’industria 5.0 sono prodotti che richiedono il coinvolgimento dell’uomo e del “tocco umano” nella loro realizzazione, con un unico imprinting dell’artigiano e del designer umano (Østergaard 2018).Il concetto di micro-fabbrica proposto da Arrival, all’opposto delle giga-fabbrica, dove rispetto alla fabbrica seriale in cui i processi di manifattura sono condotti in serie, secondo il principio del nastro trasportatore, si rende tutto più flessibile con l’introduzione della robotica mobile.Robotica collaborativa e occupazioneLa robotica collaborativa consente inoltre di ridurre la soglia di accesso per la gestione e la programmazione di queste macchine. La collaborazione uomo-robot nello spazio condiviso è infatti un potente abilitatore per il trasferimento di capacità tra esseri umani e robot, dal momento che diventa possibile la programmazione del robot attraverso la dimostrazione guidata del compito da eseguire e la manipolazione fisica del robot. Lavori recenti hanno mostrato i progressi e le prospettive di presentare le istruzioni per mezzo di robot fisicamente collaborativi utilizzando approcci di insegnamento enattivo, più simili a quello umano (Ajoudani et al. 2018).Si prevede che la prossima generazione di robot autonomi funzionerà con maggiori capacità senza o con limitata supervisione, così come la prossima generazione di robot interattivi, con capacità cognitive, sociali e fisiche intuitive, sicure ed efficienti notevolmente migliorate, per assistere ed interagire con gli esseri umani.Questo è in linea con la visione della International Federation of Robotics (IFR) che nel suo position paper su “L’impatto della robotica sull’occupazione” riconosce le crescenti esigenze di flessibilità e resilienza della produzione e come una maggiore adozione di robot offra grandi vantaggi anche per i lavoratori della produzione , creando ruoli nuovi e interessanti con nuovi profili di competenze. In Italia diversi enti si occupano della promozione della Robotica collaborativa, recentemente il Ministero dello Sviluppo Economico (MISE) ha favorito la creazione di Artes 4.0 centro nazionale di competenza incentrato proprio sulla Robotica Collaborativa e le tecnologie e sistemi digitali 4.0 abilitanti.È ampiamente dimostrato che l’automazione non porta alla sostituzione del lavoro, ma piuttosto a una riallocazione sia dei lavori che delle attività in cui i robot completano e aumentano il lavoro umano eseguendo attività di routine o pericolose. Per fare in modo che i robot si integrino e aumentino il lavoro, il futuro prevederà che robot e umani lavorino insieme, in modo che i robot sostituiranno le attività lavorative, ma non sostituiranno i posti di lavoro._NoteSLAM acronimo inglese per Localizzazione Simultanea e Ricostruzione dell’ambiente ↑BibliografiaAjoudani, Arash, Andrea Maria Zanchettin, Serena Ivaldi, Alin Albu-Schäffer, Kazuhiro Kosuge, and Oussama %J Autonomous Robots Khatib. 2018. ‘Progress and prospects of the human–robot collaboration’, 42: 957-75.EU Directorate, Reseach and Innovation. 2021. “Industry 5.0 Towards asustainable, human-centric and resilient European industry.” In, edited by European Commission.Mountz, Mick. 2012. “Kiva the Disrupter.” In Harvard Business Review.Østergaard, Esben H %J Retrieved on February. 2018. ‘Welcome to industry 5.0’, 5: 2020.Tiseni, Luca, Domenico Chiaradia, Massimiliano Gabardi, Massimiliano Solazzi, Daniele Leonardis, Antonio %J IEEE Robotics Frisoli, and Automation Magazine. 2021. ‘UV-C Mobile Robots with Optimized Path Planning: Algorithm Design and On-Field Measurements to Improve Surface Disinfection Against SARS-CoV-2’.